在數據庫服務規劃中,數據處理服務是確保數據價值得以有效挖掘和應用的關鍵環節。它位于數據存儲之后,直接面向業務分析、決策支持等應用需求。本文將基于HCIP相關知識,對數據處理服務的核心內容進行梳理。

一、數據處理服務概述

數據處理服務指對存儲在數據庫或數據倉庫中的原始數據進行加工、轉換、分析,以提取有價值信息或形成特定業務視圖的一系列服務。其核心目標是讓數據“可用”、“好用”,支撐上層業務應用。

二、主要服務類型與組件

- 數據ETL/ELT服務

- 提取(Extract):從異構數據源(如關系數據庫、NoSQL、日志文件)中抽取數據。

- 轉換(Transform):進行數據清洗、標準化、聚合、計算等操作,確保數據質量與一致性。

- 加載(Load):將處理后的數據加載到目標數據庫或數據倉庫中。

- 現代架構中,ELT(先加載后轉換)模式因云數據倉庫的強大計算能力而逐漸流行。

- 數據計算與分析服務

- 批處理計算:適用于對海量歷史數據進行離線分析,常用框架如Hadoop MapReduce、Spark等。

- 流處理計算:對實時數據流進行連續處理,用于實時監控、預警等場景,常用框架如Flink、Storm、Spark Streaming。

- 交互式查詢:提供低延遲的即席查詢服務,如使用Presto、Impala或云服務的交互式查詢組件。

- 數據開發與調度服務

- 提供可視化或代碼式的數據開發環境,用于編寫、測試數據處理任務(如SQL腳本、Python作業)。

- 配備工作流調度引擎(如Airflow、DolphinScheduler),實現復雜任務依賴的自動化定時執行與監控。

- 數據質量管理服務

- 定義和實施數據質量規則(如完整性、準確性、一致性、時效性)。

- 進行數據質量探查、監控、報告與告警,確保下游應用數據的可靠性。

三、規劃與設計要點

- 需求驅動:明確業務對數據處理的需求,如分析時效性(實時、準實時、離線)、數據規模、計算復雜度等。

- 架構選型:根據需求選擇合適的技術棧(如Lambda架構、Kappa架構),并考慮批流融合趨勢。

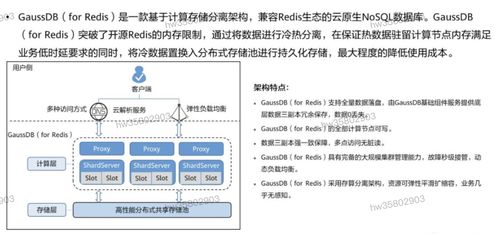

- 性能與成本平衡:合理設計數據處理流程,優化計算與存儲資源使用,在性能與成本間取得平衡(例如,使用列式存儲加速查詢,對冷熱數據采用不同存儲策略)。

- 可運維性:確保數據處理任務具備完善的監控、日志、故障恢復與重試機制,保障服務穩定性。

- 安全與合規:在數據處理過程中貫穿數據脫敏、權限控制、操作審計等安全措施,滿足合規要求。

四、在云環境中的實踐

在云數據庫服務(如華為云GaussDB、阿里云AnalyticDB等)生態中,數據處理服務通常與云存儲、計算引擎、數據湖等深度集成。關鍵實踐包括:

- 利用云上托管的ETL服務(如DataWorks、Data Lake Formation)降低運維負擔。

- 使用Serverless計算服務按需執行數據處理任務,實現成本優化。

- 借助云原生數據湖架構,實現數據在數據湖與數據倉庫間的自由流動與統一處理。

五、

數據處理服務是數據庫服務規劃中承上啟下的關鍵層。一個優秀的數據處理服務規劃,應緊扣業務目標,選擇適宜的技術架構,并充分考慮性能、成本、可運維性與安全性。在云化時代,充分利用云服務的彈性、托管與集成能力,可以更高效、經濟地構建數據處理能力,為數據驅動的業務決策提供堅實支撐。